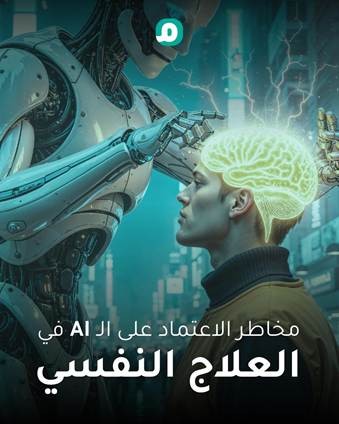

مع الانتشار السريع لأدوات الذكاء الاصطناعي، بدأ البعض يلجأ إليها كبديل أو مساعدة في العلاج النفسي. ورغم أن التكنولوجيا تقدّم حلولًا مفيدة في العديد من المجالات، إلا أن استخدامها في الصحة النفسية يحمل مخاطر كبيرة بسبب حساسية هذا المجال وارتباطه بالبشر وتجاربهم العميقة.

أحد أهم المخاطر هو غياب الفهم الإنساني الحقيقي. فالعلاج النفسي يعتمد على التعاطف، قراءة المشاعر، ملاحظة لغة الجسد، وفهم السياق الشخصي للمريض , وهي أمور لا يستطيع الذكاء الاصطناعي إدراكها بشكل كامل. وبدون هذا الفهم، قد يقدّم النظام ردودًا غير مناسبة أو سطحية، مما يجعل المريض يشعر بعدم الأمان أو عدم التقدير.

إضافة إلى ذلك، يمكن أن يؤدي الاعتماد على AI إلى تشخيصات غير دقيقة. فالذكاء الاصطناعي يعتمد على أنماط لغوية وبيانات قد لا تعكس الحالة النفسية الفعلية للشخص. وقد تخطئ الأنظمة في تفسير العواطف، أو تفشل في تحديد علامات خطيرة مثل الاكتئاب الحاد أو الميول الانتحارية، مما يعرض المريض للخطر.

كما أن مشاركة المعلومات النفسية عبر منصات الذكاء الاصطناعي تثير مخاوف كبيرة تتعلق بـ الخصوصية وسرّيّة البيانات. فالبيانات العلاجية من أكثر أنواع المعلومات حساسية، وأي اختراق أو سوء استخدام يمكن أن يسبب أضرارًا نفسية واجتماعية للمريض.

من جانب آخر، قد يشعر بعض الأشخاص بأن الذكاء الاصطناعي يوفّر لهم دعمًا دائمًا وسريعًا، مما يجعلهم يتجنّبون طلب مساعدة متخصّصة. هذا التأجيل قد يفاقم الحالات النفسية، لأن العلاج الحقيقي يتطلب متابعة مستمرة مع مختص قادر على فهم الحالة وتوجيهها بشكل صحيح.

وأخيرًا، العلاقة العلاجية بين المريض والمعالج تقوم على الثقة والإنسانية، وهو ما لا يمكن للتكنولوجيا أن تعوّضه. فالذكاء الاصطناعي يمكن أن يكون أداة مساعدة — مثل تذكير بالعلاج أو دعم مبسّط , لكنه لا يستطيع أن يكون بديلاً عن العلاج النفسي الحقيقي.